Cómo cumplir con las nuevas leyes de transparencia algorítmica

En el dinámico marco regulatorio actual, la Inteligencia Artificial ha dejado de ser una «caja negra» para convertirse en un activo sujeto al escrutinio legal y ético global. Con la plena entrada en vigor de normativas internacionales de vanguardia, las empresas ya no pueden permitirse implementar algoritmos de optimización sin un rastro de auditoría claro. Por esta razón, entender la Ética y Regulación de la IA Industrial: Cómo cumplir con las nuevas leyes de transparencia algorítmica es el requisito indispensable para cualquier organización que exporte a mercados de alta exigencia, asegurando que sus procesos automatizados sean tan legales como eficientes.

Esta adaptación es fundamental porque las sanciones por incumplimiento en la gobernanza de datos pueden alcanzar hasta el 7% de la facturación global anual de una compañía. Muchos proyectos de aprendizaje profundo (Deep Learning) se encuentran hoy detenidos a causa de sesgos algorítmicos no detectados que discriminan en la selección de personal o en la asignación de prioridades de suministro. Sin embargo, cuando se adopta la Ética y Regulación de la IA Industrial, la empresa no solo evita multas, sino que construye una «Marca de Confianza Digital» que la diferencia de competidores menos transparentes. Como bien advierte el equipo de Industriando, hoy en día la eficiencia sin ética es un riesgo financiero que ninguna planta puede asumir.

Los Tres Pilares de la Transparencia Algorítmica

Las recientes legislaciones exigen que cualquier IA que tome decisiones con impacto humano o ambiental sea explicable. Esto se desglosa en tres conceptos técnicos:

1. Trazabilidad de los Datos de Entrenamiento

La ley exige saber con qué datos se «alimentó» a la IA. Si su sistema de mantenimiento predictivo fue entrenado con datos sesgados que ignoran ciertas condiciones de falla, el algoritmo es poco fiable y potencialmente peligroso. La trazabilidad asegura que el origen de los datos sea legítimo y representativo de la realidad operativa.

2. Explicabilidad (XAI – Explainable AI)

Ya no basta con que la IA diga «detén la máquina». El sistema debe ser capaz de mostrar, en lenguaje humano, los factores que llevaron a esa conclusión. Esto es vital porque permite a los ingenieros validar la lógica de la máquina y detectar errores antes de que se conviertan en paros de línea injustificados.

3. Responsabilidad Humana (Human-in-the-loop)

La regulación prohíbe que procesos críticos sean decididos al 100% por una máquina sin supervisión. Siempre debe existir un «botón de pánico» o una instancia de validación donde un experto humano pueda anular la decisión de la IA si detecta una anomalía ética o técnica.

Auditorías de Sesgo: Evitando la Discriminación Industrial

El sesgo algorítmico no solo ocurre en redes sociales; en la industria se manifiesta de formas sutiles pero costosas.

- Sesgo en Compras: Una IA que favorece sistemáticamente a ciertos proveedores basándose en datos históricos incompletos, ignorando a nuevas empresas más eficientes o sostenibles.

- Sesgo en Recursos Humanos: Algoritmos que filtran candidatos para la planta basándose en patrones que, sin querer, excluyen a ciertos grupos demográficos, violando leyes de igualdad laboral.

La Ética y Regulación de la IA Industrial exige que las empresas realicen «Pruebas de Estrés Ético» a sus modelos antes de pasarlos a producción.

El Modelo de Evaluación de Riesgos (Risk-Based Approach)

La regulación actual clasifica las aplicaciones de IA en cuatro niveles de riesgo. Su estrategia de cumplimiento debe adaptarse a esta pirámide:

- Riesgo Inaceptable: Sistemas que manipulan el comportamiento humano o realizan calificación social (Prohibidos).

- Alto Riesgo: IA aplicada a infraestructuras críticas, salud o seguridad industrial. Requiere auditorías externas y documentación técnica exhaustiva.

- Riesgo Limitado: Chatbots o sistemas de atención al cliente. Deben informar al usuario que está interactuando con una IA.

- Riesgo Mínimo: Filtros de spam o IA de optimización de procesos internos sencillos. Solo requieren cumplir con buenas prácticas.

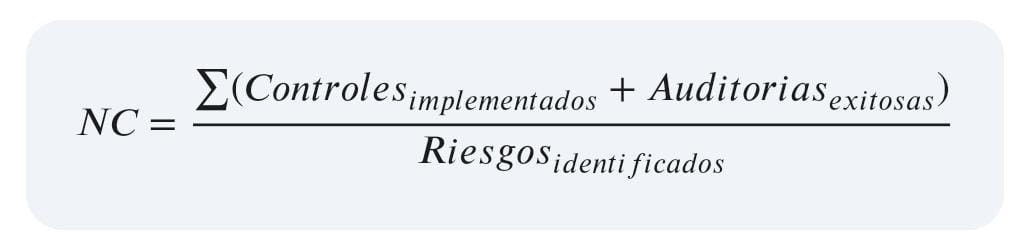

Para calcular el Nivel de Conformidad (NC): de su planta, puede usar la siguiente relación:

Mantener un NC cercano a 1 es lo que garantiza que la innovación no sea frenada por intervenciones legales repentinas.

¿Cómo Innovar bajo Regulación? El «Sandbox» Regulatorio

Muchos directores de tecnología temen que la ley mate la creatividad. Sin embargo, la normativa de 2026 introduce los Sandboxes (bancos de pruebas controlados).

Estos son entornos donde las empresas pueden probar sus IA más experimentales bajo la supervisión de la autoridad, sin riesgo de multas inmediatas mientras el modelo se ajusta a los estándares éticos. Es una oportunidad de oro porque permite fallar rápido y aprender en un marco legal seguro, acelerando el time-to-market de soluciones disruptivas.

Ciberseguridad y Ética: La Protección del Algoritmo

Como vimos en nuestra Guía de Ciberseguridad, proteger la IA es un deber ético. Si un hacker altera la lógica de su IA de control de emisiones para que mienta sobre los datos reales, la empresa es legalmente responsable del daño ambiental. La integridad del algoritmo es parte de la transparencia; un sistema que no puede garantizar que no ha sido alterado, no es un sistema transparente.

TE PUEDE INTERESAR: IA en Logística: Cómo Optimizar Rutas y Reducir la Huella de Carbono

Conclusión: La IA con Conciencia es la IA Ganadora

La regulación no es un obstáculo, sino el carril que permite que la innovación industrial alcance altas velocidades sin descarrilarse. En estos días, la transparencia algorítmica es el lenguaje de los negocios internacionales.

En conclusión, la Ética y Regulación de la IA Industrial representa el compromiso de la industria con una sociedad tecnológica más justa y segura. Las empresas que logren integrar estos principios en su ADN operativo no solo cumplirán con la ley, sino que atraerán al mejor talento y a los clientes más conscientes. Al final del día, la inteligencia artificial más potente no es la que procesa más datos, sino la que puede explicar por qué toma cada decisión, ganándose el respeto de la red y el mercado global.